生成AIの偽動画とその対策|ディープフェイクとは?

生成AIの偽動画が話題になりましたが、こうしたディープフェイク技術は、そのリアルなビジュアルと音声合成の能力で、多くの注目を集めています。一方で、その使用は倫理的な問題や様々な社会的リスクを引き起こす可能性があることも事実です。

この記事では、生成AIの偽動画などのディープフェイクがどのように機能し、ビジネスやエンターテインメントの世界でどのように活用されているのかについて探ります。また、この技術がもたらす問題点とそれに対する対策、未来の展望についても深掘りしていきます。ディープフェイクの認識から対応策まで、その全容を理解することで、私たちはより賢く、安全なデジタル世界を築くことができるでしょう。

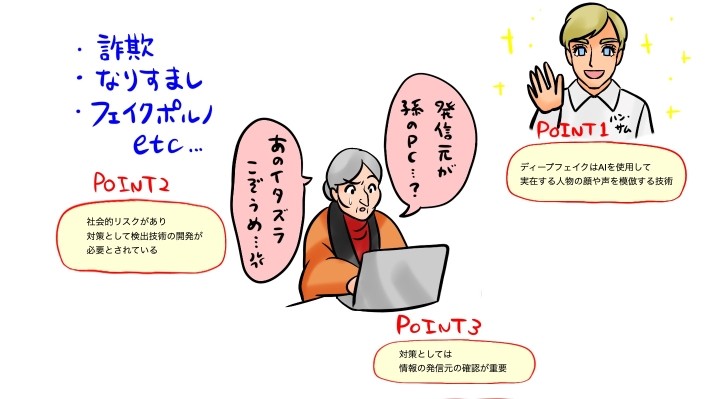

- ディープフェイクはAIを使用して、実在する人物の顔や声を模倣する技術

- 社会的リスクがあり、対策として検出技術の開発が必要とされている

- 対策としては、情報の発信元の確認が重要

ディープフェイク技術はAIを活用して、驚くほどリアルな映像や音声を生成します。ここでは、ディープフェイクがどのように機能するのか、敵対的生成ネットワーク(GAN)などの基礎技術について解説します。これらの技術がどのように現実と見分けがつかないレベルの映像を作り出すのかを理解しましょう。

ディープフェイクは、人工知能(AI)を使用して、実在する人物の顔や声を模倣する技術です。この技術は主に、映像や音声のデータを元に、実在しないがリアルなメディアコンテンツを生成します。

ディープフェイクの本質は、既存の映像や画像データに基づいて新たなコンテンツを創造することにあり、これにより、現実と区別が難しいほどリアルな偽の映像や音声が生み出されます。

GANは、ディープフェイク技術の中核を成すAIです。このシステムは、生成ネットワークと識別ネットワークの二つの部分から成り立ち、互いに競合しながら学習を進めます。

生成ネットワークはリアルな偽の画像を作成し、識別ネットワークはそれを本物と偽物とを区別します。この過程を繰り返すことで、より精巧なディープフェイクが生成されるのです。

ディープフェイクは、エンターテインメントやニュース業界での活用が進んでいます。

AIアナウンサーやリアルなCGモデルの作成など、ディープフェイクによる多様な応用例とそれが社会に与える影響を探ります。

これらの技術がどのように現代社会の情報伝達やコンテンツ制作を変えているのかを紐解きます。

ディープフェイク技術は、ニュースキャスターやモデルとしての使用で注目されています。

AIが生成した顔や声を用いることで、実際に存在する人間を必要とせず、効率的にニュースを読み上げたり、ファッションモデルを演じることが可能になります。

これにより、制作コストの削減や新たなクリエイティブな表現が可能になります。

ディープフェイクは、映画や音声コンテンツの多言語化にも大きな可能性を持っています。例えば、映画の吹き替えにディープフェイクを使用することで、異なる言語圏の視聴者に対して、自然な口の動きと同期した音声を提供することができます。

これは、映画産業において、より多くの視聴者にリーチするための重要な手段となり得ます。

ディープフェイク技術は、政治やソーシャルメディアにも大きな影響を与えています。政治家のなりすましやフェイクニュースの生成など、ディープフェイクによる社会的・政治的な影響を詳しく検証します。これらの影響が民主主義や公共の議論にどのように作用しているかを理解することが重要です。

ディープフェイク技術の潜在的な危険性の一つは、政治的な偽情報の拡散です。政治家の発言や行動を捏造したディープフェイク動画が流布されることで、公共の意見形成に誤った影響を与える可能性があります。これは民主主義に対する深刻な脅威となり得ます。

ディープフェイク技術の普及により、メディアの信頼性に対する疑念も高まっています。真実であるかのように見える偽の映像や音声が簡単に作成されるため、ニュースや情報の真偽を判断することがより困難になります。

これは、社会における情報の質と信頼性を保つための新たな挑戦を提示しています。

ディープフェイクには多くのリスクが伴います。詐欺、なりすまし、フェイクポルノなど、ディープフェイクによる問題点を明らかにし、これらのリスクにどう対処するかについて解説します。検出技術の進歩や法的な規制の必要性など、ディープフェイクのリスク管理に関する有効な対策を探ります。

ディープフェイクは、詐欺やなりすましの手段として利用されることがあります。例えば、有名人や親しい人を装った偽のビデオメッセージを用いて、個人情報を騙し取る詐欺が発生しています。このような行為は、個人の信頼関係を損ない、経済的損失をもたらす可能性があります。

騙されないための対策としては、情報の発信元をしっかり確認し信頼できるメディアであるかチェックすることが重要です。

ディープフェイク技術を悪用した例の中でも、特に問題視されているのがフェイクポルノです。これは、実在する人物の顔を無断でアダルトコンテンツに合成する行為で、被害者のプライバシーを深刻に侵害します。この問題は、デジタル時代の個人の権利と尊厳を守る上で大きな課題となっています。

ディープフェイクのリスクに対処するため、検出技術の発展が進められています。この技術は、偽の映像や音声を識別し、それがディープフェイクによって生成されたものであるかを判定します。このような技術の進歩は、ディープフェイクによる被害を最小限に抑えるために不可欠です。

ディープフェイク技術は、GANなどの先進的なAI技術を用いて、現実と見分けがつかない映像や音声を生み出します。

これにより、ビジネスやエンターテイメント分野では革新的な可能性を秘めていますが、同時に詐欺、フェイクポルノ、政治的なりすましなど、深刻な問題を引き起こすリスクも抱えています。

このため、ディープフェイクの検出技術の開発や法的規制の検討が急がれています。また、一般の人々もディープフェイクを見分けるための方法を学び、情報を精査する必要があります。ディープフェイクの未来は、技術の進化とともに倫理的なガイドラインの確立が不可欠です。

PHOTO:iStock

TEXT:PreBell編集部

- tag

この記事を気にいったらいいね!しよう

PreBellの最新の話題をお届けします。