ディープフェイクとは?活用例や悪用のリスク、その対策について解説

2024年以降、ディープフェイクがアプリ上で簡単に利用できるようになり、さまざまな場面で話題になっています。

しかし、そのリスクも同時に懸念されており、名誉毀損や著作権法違反、選挙妨害といった問題が浮上しています。

今回は、ディープフェイクの活用事例と共に、注目を集める悪用リスクとそれに対する企業の対策を詳しく解説します。

- 目次

ディープフェイクとは

ディープフェイクは、AIを使用して人物の動画や音声を人工的に合成する技術で、「フェイク動画」の代名詞になっています。

本来はエンターテインメント目的で開発されましたが、現実の映像や音声を加工して偽の情報を作り出すため、悪用が懸念されています。

現在では、技術の進歩により、人の顔や口元などをリアルに再現できるようになり、本物と区別がつかないレベルにまで到達しました。

ディープフェイクの有効活用

ここでは、ディープフェイクの有効な活用例として、著作権フリーのAIモデル作成と自動翻訳吹き替えについて紹介します。

著作権フリーのAIモデル作成

ディープフェイク技術は、著作権や肖像権の制約を受けず、高品質なオリジナルコンテンツを作成しやすいのが特徴です。

顔の特徴を持つモデルが見つからない場合でも、望む顔のモデルが作成できます。

AIモデルの画像や動画はさまざまなビジネスでの活用が可能で、タレントの代役や販売員の業務を代行するビジネスなどが進んでいます。

例えば、AI model社の「AI model(AIモデル)」は、AIでファッションモデルを生成し、アパレル企業のDXを支援するサービスを提供しています。

大手ファッションブランドや人気ショップなどで展開されており、ブランドの世界観を表現するためのモデル撮影の効率化や、クリエイティブの表現の幅を広げるために注目されています。

自動翻訳吹き替え

音声のディープフェイクを活用した自動翻訳吹き替えにも注目が集まっています。

2023年6月、YouTubeはAIによる吹き替え音声として英語・スペイン語・インドネシア語・ポルトガル語・ヒンディー語の切り替えが可能になると発表しました。

この機能は、Googleの「Aloud」というAIを利用しています。

驚くべきは、ムービーの後ろで流れているBGMはそのままに、自分の声のまま別言語に翻訳されて吹き替えられている点です。

この機能は、2024年内に正式に実装される予定です。

ディープフェイク技術の悪用リスク

AIによるディープフェイクを駆使した映像や音声の合成技術が進歩する一方で、それらが悪用される事例も増えてきています。

特に注目すべきは、選挙の投票妨害やソーシャルメディアでの個人の名誉毀損など、深刻な影響を及ぼす可能性のある事例です。

選挙の投票妨害

米国の大統領選挙で、バイデン大統領にそっくりな偽の自動音声を使って投票を妨害する行為が発覚しました。

この音声は、生成AIによる「ディープフェイク」で、電話を通じて有権者に「投票を控えるよう」促す内容が伝えられました。

このような行為は選挙の公正性を損なうものであり、法的な規制が必要とされています。

TikTokでの「芸能人エフェクト」

ソーシャルメディアのTikTokでは、芸能人・著名人風の顔になれるAIフィルター(芸能人エフェクト)が流行しています。

しかし、これらのフィルターの自由な利用が、ディープフェイクとして悪用される懸念を抱かせているのです。

実際、2020年には、ディープフェイクによる芸能人の偽わいせつ動画の作成、公開により、大学生とエンジニアの2人が名誉毀損と著作権法違反の疑いで逮捕されました。

ディープフェイク技術の進歩は、便利さと同時にこのようなリスクも生んでいます。

その悪用が社会問題となりつつあり、法的な措置や倫理的なルール作りが求められています。

ディープフェイク被害防止対策を行う企業

ディープフェイクによる被害防止対策を積極的に行う企業が存在します。

今回は特にMicrosoftとIntelの取り組みを紹介します。

Microsoftの取り組み

2020年9月、Microsoftはディープフェイクを特定し、不適切なコンテンツがインターネット上で拡散されるのを防ぐツール「Microsoft Video Authenticator(マイクロソフト・ビデオ・オーセンティケーター)」を発表しています。

このツールは、写真と動画の両方を分析可能で、不正に加工されたコンテンツかどうかを調べることができます。

Microsoftはまた、すべての人工知能検出技術には誤検出があり得ると指摘した上で、既存の検出技術で見過ごされたディープフェイクについて、対応策を練る必要があると主張しました。

この技術は主に二つの要素によって構成されます。

一つ目は、コンテンツ作成者がハッシュ値や証明書を添付できる仕組みで、これはMicrosoft Azureに統合されています。

二つ目は、ユーザーが証明書とハッシュ値をチェックすることで、コンテンツの信憑性を確認できる仕組みです。

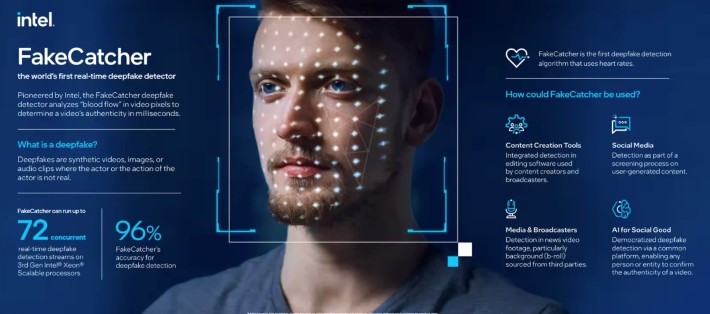

Intelの取り組み

2022年11月、Intelは96%の精度でフェイク動画を検出できるというディープフェイク検出技術「FakeCatcher」を製品化したと発表しました。

FakeCatcherはミリ秒単位の速さで結果を返すことができ、リアルタイムでの検出が可能となっています。

FakeCatcherは、心臓が血液を送り出した際に発生する静脈の色の変化を、動画に映る顔から収集し、これを元にディープラーニングで即座に本物か偽物かを判別します。

ディープフェイクの被害防止対策は、技術の進歩とともにそれを悪用する人々の手口も進化するため、常に最新の対応が求められます。

MicrosoftとIntelのような企業の取り組みは、この問題に対する一つの答えとなるでしょう。

ディープフェイクの今後についてのまとめ

この記事では、ディープフェイクの技術について、その可能性と並行して存在するリスクについても触れてきました。

ディープフェイクは、そのリアルさからさまざまな分野での活用が広がっています。

しかし、その一方で、偽情報の拡散やプライバシー侵害といった重大な課題も抱えています。

これは、ディープフェイクの潜在的な誤用に対する慎重な対応を必要としています。

特に、偽情報の拡散は、社会全体に混乱を招く可能性があります。

ディープフェイク検出技術の進化と並行して、法的な規制や社会的なルール作りが進展していくことが求められています。

テクノロジーの発展は止まらないため、それを適切に管理するためのルールや法律も順次更新されていくべきです。

ディープフェイクの未来は、その利便性を楽しみながら、リスクに対して備えることで、より良くなることを望んでいます。

関連記事

TEXT:PreBell編集部

PHOTO:iStock

この記事を気にいったらいいね!しよう

PreBellの最新の話題をお届けします。